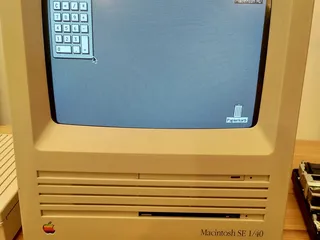

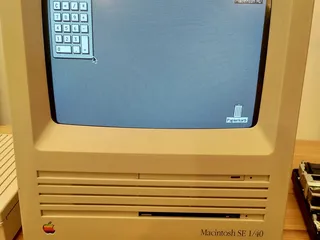

Hab mal wieder einen Ausflug in die Apfel-Welt unternommen

So ein http://www.knubbelmac.de/ ist auch einfach ein Computer zum knuddeln!

Zufällig wollte Claus77 einen SE 1/40 los haben, den er mir freundlicherweise verkauft hat.

Weil der Zustand unbekannt war, hab ich das Gerät zuhause erst mal zerlegt und grob gereinigt. Erste positive Überraschung: Die Batterie ist glücklicherweise nicht ausgelaufen und hat somit keinen Schaden angerichtet. Nur ein RAM Riegel hatte sich gelöst und lag lose im Gehäuse und bei den SIMM Sockeln waren zwei seitliche Arretierungen abgebrochen. Sonst sieht das Board noch prima aus. Ich musste nur den Staub abblasen und ein paar kleinere Schmutzflecken entfernen.

Im Gegensatz zu meinem anderen SE-Board, wo die SMD Elkos mittlerweile teilweise ausgelaufen waren, hat dieses Board noch herkömmliche Elkos, die alle noch intakt sind. Auch sonst sieht alles im Inneren noch gut aus.

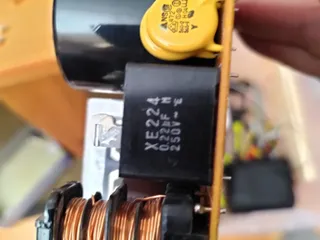

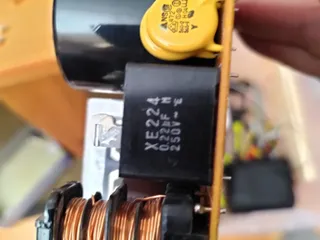

Das Netzteil hab ich ebenfalls geöffnet und gereinigt. Dort sind zwar keine fiesen RIFA’s verbaut, aber mir ist nicht ganz klar, ob die Netzfilter Kondensatoren trotzdem getauscht werden sollten? Was sagen die Mac-Profis?

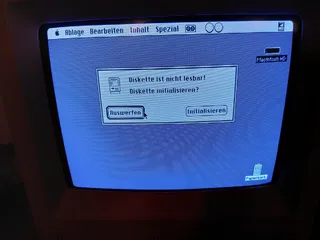

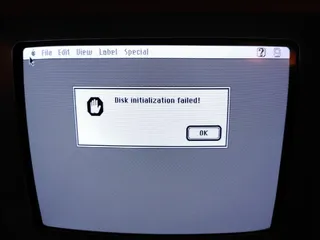

Das Diskettenlaufwerk macht leider mehr Stress. Die auseinander stehenden Schreib-/Leseköpfe konnte ich zwar wieder zurechtbiegen, damit der Mac davon booten konnte. Aber eine Diskette lässt sich leider nach wie vor nicht formatieren. Lässt sich hier noch was machen, oder hilft nur ein Tausch?

Überraschenderweise startete der Mac auch von der Festplatte anfangs ohne Probleme - zumindest einmalig. Am nächsten Tag weigerte sich der Computer jedoch plötzlich beharrlich von der Quantum-Platte zu booten.

Was war über Nacht passiert? Die Platte läuft zwar an, klackt kurz, aber dann passiert nichts mehr. Googeln brachte die Lösung: Die „Bumper-Gummis“, also die Begrenzer für den Arm der Schreib-/Lese-Köpfe, in der Quantum ProDrive lösen sich nach 40 Jahren auf und sind nur noch eine klebrige Masse, was dazu führt, dass der Arm daran kleben bleibt. Anscheinend nicht unüblich bei so alten Festplatten. Das bedeutete also Reparatur am offenen Herzen: Die klebrige Masse an den Dornen habe ich entfernt und durch REV Isolierband ersetzt – pragmatisch, aber funktioniert! Die Finger wieder sauber zu bekommen hat länger gedauert

Ergebnis: Mac bootet wieder zuverlässig von Festplatte, Diskettenlaufwerk kann zum Lesen von Disketten verwendet werden, aber formatiert keine Disketten.

Frage: Kann man das Floppylaufwerk doch noch irgendwie reparieren?

Jedenfalls ist der Mac SE soweit instand gesetzt und damit wieder ein ziemlich knuddeliges Gerät